信息定制聊天机器人NVIDIA为WithChatPCRTXRTXAI

Chat with RTX 工具支持包括 .txt、.pdf、.doc/.docx 和 .xml 在内的多种文件格式。将应用程序指向含有这些资料的文件夹,Chat with RTX 工具就会在几秒钟内将它们载入到资料库中。

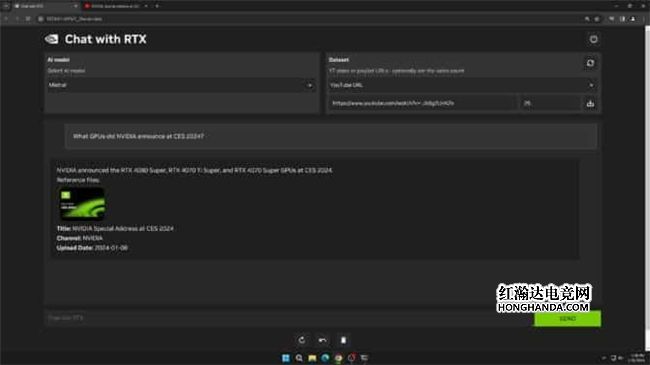

Chat with RTX 借助检索增强生成(RAG)、NVIDIA TensorRT-LLM 软件及 NVIDIA RTX 加速技术,将生成式AI功能引入由GeForce 赋能的本地 Windows PC。用户可快速轻松地将桌面端上的资料当成数据集,连接到 Mistral 或 Llama 2 这一类开源大型语言模型,以便快速查询与上下文有关的内容。

用户还能加入 YouTube 视频和播放列表里的信息。在 Chat with RTX 里加入视频网址,用户便能将这些知识与聊天机器人进行整合,进行上下文查询。例如根据最喜欢的旅游KOL所发布的视频内容来询问推荐的旅游内容,或是按照顶尖教育资源获取快速教学和操作方法。

深入了解 Chat with RTX。

除了需要配备 GeForce RTX 30 系列或更高版本的 GPU (至少 8GB 显存),使用 Chat with RTX 还需要搭配操作系统 Windows 10 或 11 和最新的 NVIDIA GPU 驱动。

这个技术展示Demo让任何拥有 RTX GPU 的人都能享受强大的个人定制化的 GPT 聊天机器人。

问我一切

用户只要输入查询内容即可,无需搜寻笔记或储存的内容。例如用户可以问:「我的合作伙伴推荐拉斯维加斯的哪家餐厅?」Chat with RTX 工具就会扫描用户指向的桌面端资料,并且按照上下文提供答案。

February 13, 2024 by Jesse Clayton

Chat with RTX 展现出利用 RTX GPU 加速 LLM 的潜力。这款应用使用 GitHub 上的 TensorRT-LLM RAG 开发者参考项目构建而成。开发者可以使用该参考项目,为 RTX 开发和部署私人以 RAG 为基础的应用,并且由 TensorRT-LLM 进行加速。深入了解如何建立以 LLM 为基础的应用。

编注:目前 Chat with RTX 中存在一个问题,用户选择不同的安装目录时,会造成安装失败。我们将在日后的版本中修复这个问题。目前用户应使用默认的安装目录(「C:Users

https://www.youtube.com/watch?v=gdsRJZT3IJw

Chat with RTX 技术演示版,现已开放免费下载,用户可在搭载 NVIDIA GeForce RTX 30 系列或更高版本的 GPU(至少 8GB显存)进行本地部署,打造个人专属聊天机器人。

在基于 NVIDIA GPU 的云端服务器支持下,全球每天有数百万人使用聊天机器人。现在这些开创性的工具将出现在搭载 NVIDIA RTX的 Windows PC 上,以实现本地、快速、信息定制的生成式AI。

Chat with RTX 可以在 Windows RTX PC 和工作站上以本地部署的方式运行,再加上用户的数据还是保留在本地设备装置上,因此能够快速提供查询结果。与依赖云端环境的 LLM 服务不同,Chat with RTX 让用户能够在 PC 桌面端处理敏感资料,无需分享给第三方或是连接到网络。

使用 RTX 开发以 LLM 为基础的应用

Chat with RTX 可以将 YouTube 影片内容的知识加入查询结果。

更多精彩电竞资讯,请持续关注红瀚达电竞网 (https://www.honghanda.com/)- 2026-01-31 第五代骁龙8如何凭借全自研内核成就全能旗舰

- 2026-01-31 X870ETOPX3DAMDRyzen处理器打造:技嘉X3DAORUS专为XTREMEAI旗舰主板正式上市

- 2026-01-31 格拉纳达足球俱乐部高层访华,深化与中国足球的文化与竞技交流

- 2026-01-31 一文看懂「星广联投」高分素材丨锚定优质内容,学会高分素材制作TIPS

- 2026-01-30 6》开放特殊免费试玩活动2025年最畅销第一人称射击游戏、多项提名大作《战地风云

- 2026-01-30 平台!STEAM、PS和科幻恐怖游戏《A.I.L.A》正式登陆Xbox

- 2026-01-30 首款鸿蒙全场景独家游戏《太吾绘卷》官宣!华为MateX7定义跨端游戏新范式

- 2026-01-30 腾讯Q3业绩延续增长势头,瓦手成为年度最成功新游

- 2026-01-30 Steam黑五疯狂折扣来袭,散帅们准备好过属于自己的“双十一了吗”

- 2026-01-30 当电竞遇上苏绣:《坦克世界》国际冠军赛织就文化交融新篇章

- 2021欧洲杯小组赛赛程,出线规则是怎样的

- 《三角洲行动》“双子测试”评测!耕升40SUPER系列为国游加速!RTX

- 三分钟读懂任天堂Switch Lite 不能连电视但续航时间延长半小时

- 和平精英:XQF逆袭夺冠 “伞兵”成为全场最高击杀王

- RX性价比远超RTX10GB显卡评测6750GRE4060!撼讯

- 连续六年散热技术迭代,控温大师2.0——飞智手机散热器B7X系列全网霸榜

- 2021欧洲杯分组抽签规则,最终分组情况

- 欧洲杯预选赛积分排名,最新积分榜情况

- BO5打满将登场50个英雄,全局BP新规:登场过的英雄双方都不可用

- 年电竞赛季计划无畏契约冠军巡回赛(VCT)公布2025

- 和平精英全新套装向日葵先生上线 最大的用途竟然是撩妹

- 无畏契约冠军巡回赛(VCT)公布2025年电竞赛季计划

- 外媒评选25款2019年最佳安卓游戏 绝地求生手游上榜

- DNF:2022年双至尊提升率!4千块增加7%伤害

- 三国志战略版程普低配吴枪,没草船军民可玩